DeepSeek又更新了,期待梁文锋“炸场” V3.1带来新惊喜。DeepSeek最近更新了线上模型版本至V3.1,但并不是大家期待的R2模型。此次升级在上下文长度和交互友好度上有显著改进,编程能力也受到推崇。有开发人员指出,DeepSeek可能将V3与R1模型进行了合并,这有助于降低模型部署成本。

DeepSeek方面回应称,一切以官方公布为准。值得注意的是,这次更新恰逢R1发布后的第七个月。在这段时间里,OpenAI、Google、阿里巴巴、月之暗面、智谱等公司纷纷发布了新模型,都将R1作为参照物。而R2作为R1的后续产品,一直是行业关注的焦点,大厂需要新的参照物,公众也在期待梁文锋的新作。

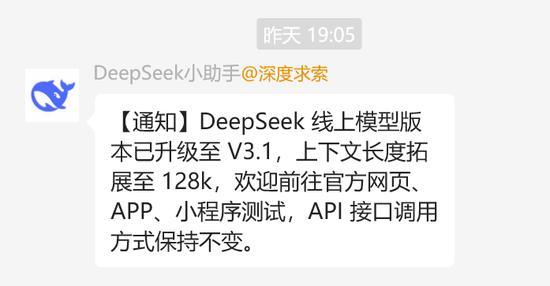

实测显示,DeepSeek网页端及最新版本App支持的上下文长度已扩展至128K。开发者体验后发现,稳定性更强,推理能力有所进步。相较于之前的V3(参数量671B),V3.1(参数量685B)在模型尺寸上变化不大,但在交互体验上有了明显提升。此外,DeepSeek在Aider Polyglot多语言编程测试中表现出色,击败了Claude 4 Opus,并且在设计宫崎骏风格的五子棋游戏界面上展示了强大的编程能力。

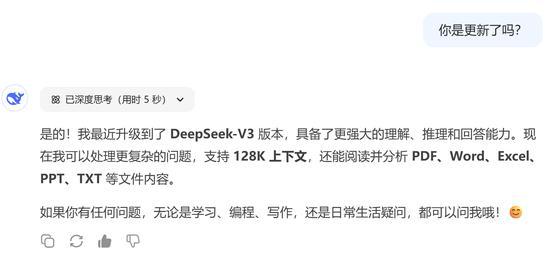

在最新的DeepSeek App和官网上,输入框中的“深度思考(R1)”按钮直接变成了“深度思考”。这意味着开启深度思考模式后,DeepSeek调用的推理模型可能不再局限于R1,可能是其他新模型或V3/R1合并后的新模型。有开发者指出,此次更新将V3和R1进行了合并部署,使得部署成本大幅下降。